互信息

出自 MBA智库百科(https://wiki.mbalib.com/)

互信息(Mutual Information)

目錄 |

一般而言,通道中總是存在著雜訊和干擾,信源發出消息x,通過通道後信宿只可能收到由於干擾作用引起的某種變形的y。信宿收到y後推測信源發出x的概率,這一過程可由後驗概率p(x|y)來描述。相應地,信源發出x的概率p(x)稱為先驗概率。我們定義x的後驗概率與先驗概率比值的對數為y對x的互信息量,也稱交互信息量(簡稱互信息)。

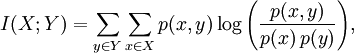

互信息是指資訊理論里一種有用的信息度量,它是指兩個事件集合之間的相關性。兩個事件X和Y的互信息定義為: 又可以表示成:

又可以表示成:

I(X;Y) = H(X) − H(X | Y)

= H(Y) − H(Y | X)

= H(X) + H(Y) − H(X,Y)

= H(X,Y) − H(X | Y) − H(Y | X)

其中H(X,Y)是聯合熵(Joint Entropy),其定義為:

H(X|Y)是條件熵(conditional entropy),定義重屬於熵的定義。

互信息是計算語言學模型分析的常用方法,它度量兩個對象之間的相互性。在過濾問題中用於度量特征對於主題的區分度。互信息的定義與交叉熵近似。互信息本來是資訊理論中的一個概念,用於表示信息之間的關係, 是兩個隨機變數統計相關性的測度,使用互信息理論進行特征抽取是基於如下假設:在某個特定類別出現頻率高,但在其他類別出現頻率比較低的詞條與該類的互信息比較大。通常用互信息作為特征詞和類別之間的測度,如果特征詞屬於該類的話,它們的互信息量最大。由於該方法不需要對特征詞和類別之間關係的性質作任何假設,因此非常適合於文本分類的特征和類別的配準工作。